FinOps à l'ère de l'IA : comment maîtriser les coûts cloud face à une nouvelle complexité

Clément Mary

Leader Practice Data & AI chez Claranet France

Qu'est-ce que le FinOps à l'ère de l'intelligence artificielle ?

Le FinOps (Financial Operations) désigne la discipline qui consiste à piloter et optimiser les dépenses liées aux infrastructures cloud. À l'ère de l'intelligence artificielle, son périmètre s'étend désormais à l'ensemble des dépenses technologiques : cloud, SaaS, licences et workloads IA, pour répondre à une question structurante : combien coûte réellement un usage métier ?

En 2025, les dépenses mondiales en cloud public dépassent 500 milliards de dollars (Gartner, 2025). Plus de 80 % des entreprises déclarent utiliser des technologies d'IA dans leurs opérations. Cette adoption massive s'accompagne d'un retour du gaspillage cloud, estimé à près de 30 % des budgets engagés. Dans ce contexte, la maîtrise financière des environnements IT devient un enjeu critique pour toute organisation.

Dimension | FinOps Traditionnel | FinOps IA |

|---|---|---|

| Périmètre | Infrastructure cloud (VM, stockage, réseau) | Cloud + abonnement SaaS + consommation à l’usage + licences |

| Unité de coût | Coût par machine / environnement | Coût par requête / volume de tokens / cas d'usage |

| Prévisibilité | Élevée (ressources dimensionnées) | Faible (variable selon les usages) |

| Principal risque | Instances oubliées, surdimensionnement | Shadow IA, explosion de consommation de tokens |

| Levier clé | Rightsizing, scheduling, tagging | Gouvernance IA (gateway AI, choix des modèle en fonction des usages, limitations, suivi en production) |

| Dimension environnementale | Secondaire | Centrale (GPU énergivores, mix électrique) |

| Outils de mesure | Google Cloud Cost, AWS Cost Explorer | Outils natifs IA (gateway AI + outils observabilité spécialisés IA) + ACV + métriques carbone |

Pourquoi l'IA transforme-t-elle profondément les coûts cloud ?

L'intelligence artificielle introduit une rupture fondamentale dans la nature même des coûts IT. Là où les infrastructures classiques reposaient sur des ressources identifiées et relativement stables : machines virtuelles, stockage, bases de données, les workloads IA génèrent des coûts structurellement différents, plus variables et plus difficiles à anticiper.

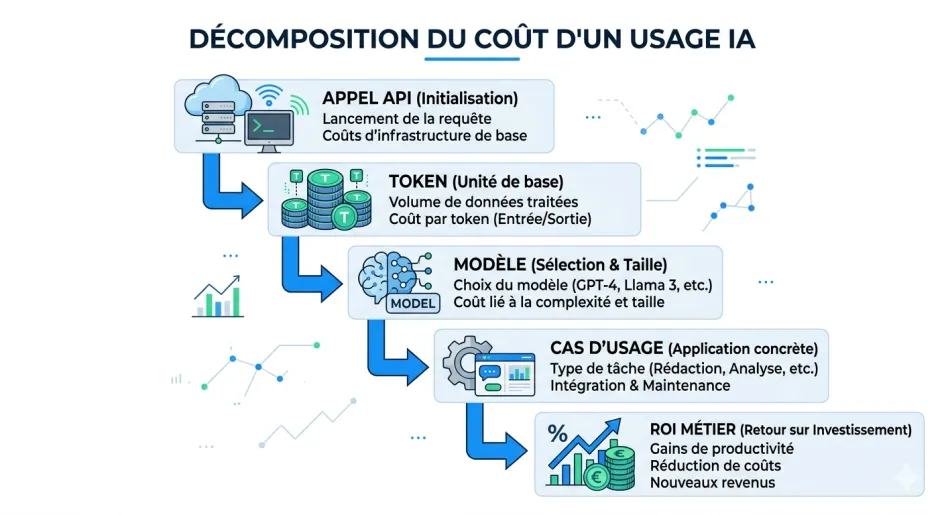

Des infrastructures beaucoup plus coûteuses

Les workloads IA reposent massivement sur des GPU, dont les tarifs sont significativement supérieurs aux CPU traditionnels. À cela s'ajoutent des modèles de facturation à l'usage basés sur des unités comme les tokens ou les requêtes, qui rendent la prévision budgétaire beaucoup plus complexe. Un service basé sur un modèle d'IA générative peut voir ses coûts varier fortement d'un mois à l'autre selon les usages, sans qu'aucune modification d'architecture n'ait été réalisée.

Une multiplication des sources de coûts

Le modèle économique de l'IA est fragmenté : données, entraînement, inférence, API externes. Chacune de ces composantes génère des coûts distincts, difficiles à consolider et encore plus difficiles à relier à la valeur métier produite. C'est précisément pour cette raison que le FinOps traditionnel, historiquement centré sur la réduction des coûts d'infrastructure cloud, doit évoluer vers une discipline plus globale.

Un nouveau Shadow IT

Comme lors de la transition vers le cloud public, l'accessibilité des outils IA ouvre la porte à un nouveau Shadow IT. Sans gouvernance, un collaborateur peut souscrire à un service IA, avoir une consommation assez élevée rapidement en fonction de son usage, sans validation explicite du service IT. La simplicité d'accès introduit un potentiel d'explosion des dépenses similaire à celui observé lors de la démocratisation du cloud.

Comment le FinOps évolue-t-il face à l'IA ?

Le FinOps ne se limite plus à l'optimisation de la facture cloud. Il devient un outil de pilotage économique global, capable de répondre à des questions métiers précises sur la valeur réelle de chaque initiative technologique.

De nouvelles métriques orientées usage

Les équipes FinOps introduisent désormais des métriques plus proches des usages réels :

- Coût par requête : combien coûte chaque appel à un modèle IA ?

- Coût par utilisateur ou par équipe : qui consomme quoi, et pour quel usage ?

- Coût par modèle : quel modèle LLM est utilisé, pour quelle tâche, à quel prix ?

- Coût par cas d'usage : quelle est la valeur réelle d'une initiative IA par rapport à son coût total ?

Ces métriques doivent être croisées avec des indicateurs de valeur. Pour un projet IA visant à améliorer la productivité, le calcul doit intégrer le coût des ressources IA, le temps de développement de la solution, sa maintenance et le temps gagné par son utilisation. Toute la chaîne de valeur doit être prise en compte.

La collaboration finance-IT-métier reste centrale

La transparence des coûts, via des mécanismes de showback (visibilité des coûts par équipe sans refacturation) ou de chargeback (refacturation interne effective), reste un levier clé de responsabilisation. Ces mécanismes permettent aux décideurs de comprendre qui consomme quoi et de prendre des décisions d'arbitrage éclairées.

Les bonnes pratiques historiques restent valables mais leur impact est amplifié

Le tagging des ressources, l'arrêt des environnements inutilisés et l'optimisation du dimensionnement continuent de s'appliquer. Mais dans un contexte IA, leur impact est amplifié : une mauvaise configuration dans un environnement GPU peut entraîner des coûts dix fois supérieurs à ceux d'un environnement cloud classique mal optimisé.

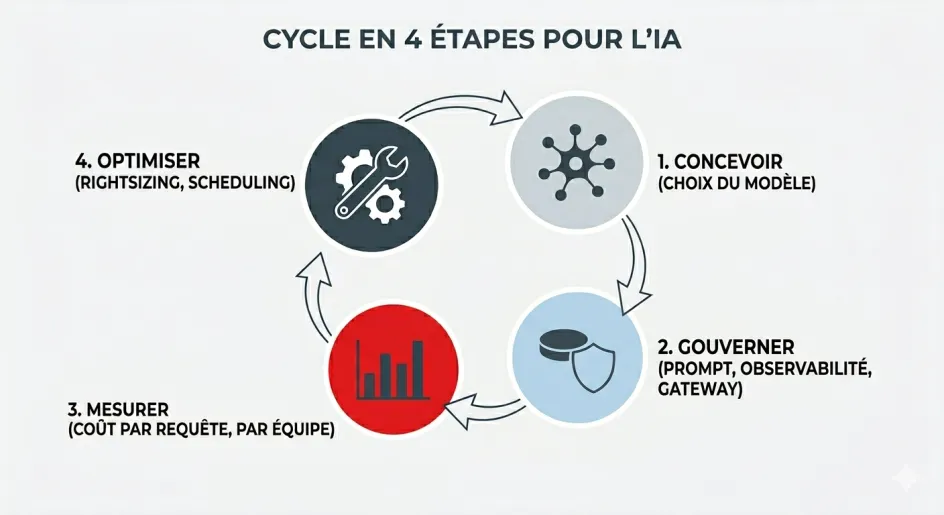

Qu'est-ce que le FinOps "by design" appliqué à l'IA ?

Le FinOps "by design" consiste à intégrer la dimension financière dès la conception d'un projet, avant même son déploiement. Dans un contexte IA, les choix d'architecture ont un impact direct et immédiat sur les coûts.

Les 4 paramètres à arbitrer en amont

Quatre décisions structurantes influencent directement le coût d'un service IA :

- Le choix du modèle : un LLM surdimensionné pour une tâche simple multiplie inutilement les coûts. Des outils comme l'Azure AI Foundry model router permettent de sélectionner en temps réel le meilleur modèle en évaluant simultanément le coût, la performance et la complexité de la requête.

- La fréquence d'utilisation : chaque appel génère un coût. La gouvernance des usages, notamment via des limites de tokens ou des enveloppes budgétaires, est un levier direct de maîtrise.

- Le type d'infrastructure : GPU mutualisé ou dédié, cloud public ou hébergement souverain. Chaque choix a des implications financières et environnementales significatives.

- Le mode de traitement : le traitement en temps réel est systématiquement plus coûteux que le traitement par batch. La question du besoin réel en temps réel doit être posée pour chaque cas d'usage.

La gouvernance du prompt comme levier d'optimisation

Une gouvernance active autour du prompt permet de réduire significativement les coûts sans dégrader la qualité des réponses. Trois pratiques produisent des résultats mesurables :

- Supprimer les informations superflues : n'intégrer dans le contexte que ce que le modèle utilisera réellement. Pour une analyse de logs, seule la portion présentant une erreur est pertinente, pas l'intégralité du registre.

- Repartir de zéro plutôt qu'insister : relancer une requête non satisfaisante dans le même fil de conversation recharge l'intégralité du contexte précédent. Il est préférable d'ouvrir une nouvelle conversation.

- Éviter les échanges superflus : remercier un modèle génère une nouvelle requête qui recharge le contexte. Chaque interaction a un coût direct et mesurable.

La définition de budgets comme garde-fou structurel

La définition et l'application de budgets à plusieurs niveaux constitue une solution efficace pour éviter les dérives. Un exemple concret : une enveloppe de 50 € par mois par utilisateur, couplée à une limite de 300 € pour son équipe, au sein d'un budget total de 8 000 € par mois pour l'ensemble de l'entreprise. Ce dispositif remplit une double fonction : étouffer les explosions de consommation individuelles et réduire le Shadow IT en rendant chaque dépassement visible et soumis à validation managériale.

Comment l'IA devient-elle un outil au service du FinOps ?

L'IA n'est pas seulement un objet de pilotage pour le FinOps. Elle devient également un outil au service de cette discipline. Les solutions FinOps les plus avancées intègrent désormais des capacités d'automatisation : détection automatique des anomalies de consommation, recommandations d'optimisation contextualisées, ajustement dynamique des ressources.

L'apport le plus concret de l'IA générative réside dans l'intégration du langage naturel : il devient possible de générer une liste d'indicateurs ou de graphiques avec une simple phrase, ou d'obtenir un compte-rendu rédigé expliquant une augmentation soudaine de consommation cloud, sans requête SQL ni manipulation de tableau de bord.

Il convient néanmoins de rester vigilant face aux arguments commerciaux : la mention "powered by AI" ne garantit pas une amélioration substantielle par rapport à des méthodes statistiques classiques, notamment pour la détection d'anomalies sur des séries temporelles.

Quel est l'impact environnemental des workloads IA ?

L'essor de l'IA ne peut être dissocié de son impact environnemental, souvent sous-estimé dans le contexte d'enthousiasme autour des gains de productivité qu'elle promet.

Selon un rapport de l'Agence Internationale de l'Énergie publié en avril 2025, l'IA représentait 15 % de la consommation électrique totale des datacenters en 2024, une part qui pourrait atteindre 50 % dès 2025. En termes d'émissions, l'IA aurait été responsable en 2024 d'émissions de gaz à effet de serre équivalentes aux émissions annuelles d'une ville comme New York (AIE, 2025).

Une empreinte qui dépasse les seules émissions de CO₂

L'empreinte environnementale des systèmes IA s'étend au-delà des émissions de gaz à effet de serre. Une estimation complète doit suivre la méthodologie d'Analyse de Cycle de Vie (ACV), qui intègre les impacts sur l'ensemble de la chaîne : fabrication, transport, assemblage, utilisation et fin de vie des équipements. Elle est également multicritère : consommation d'eau, de terres rares, effets sur la biodiversité, autres formes de pollution. Au niveau européen, 16 indicateurs sont définis pour évaluer l'ensemble de ces impacts environnementaux.

La localisation des datacenters : un facteur déterminant

Un rapport ACV publié en mars 2025, issu du programme de recherche français Alt IMPACT, apporte des données concrètes sur la répartition des impacts selon les phases du cycle de vie d'un GPU. La phase d'utilisation représente entre 70 et 90 % de l'empreinte totale, respectivement en contexte d'inférence et d'entraînement. Pour un même modèle GPU, les émissions de gaz à effet de serre sont environ 4 fois supérieures aux États-Unis et 6 fois supérieures en Chine par rapport à la France, une différence presque entièrement due aux modes de production d'électricité utilisés dans ces pays.

FinOps et GreenOps : une convergence naturelle

Optimiser les coûts IA revient souvent, de manière indirecte, à optimiser l'empreinte carbone. Réduire un volume de calcul inutile, limiter les appels à des modèles surdimensionnés ou mieux gérer les cycles d'entraînement permet simultanément de diminuer la facture et l'impact environnemental. Cette convergence entre FinOps et GreenOps constitue l'un des piliers de l'offre FinGreenOps de Claranet, qui traite simultanément la performance économique et l'impact environnemental du cloud.

La sobriété reste la meilleure des pratiques : malgré la puissance des outils IA, l'effort cognitif naturel demeure toujours moins émetteur qu'une requête à un modèle génératif.

FAQ

Quelle est la différence entre FinOps traditionnel et FinOps IA ? Le FinOps traditionnel optimise les coûts d'infrastructure cloud (machines virtuelles, stockage, réseaux). Le FinOps IA étend ce périmètre aux workloads IA, GPU, tokens, API, modèles et introduit des métriques orientées usage métier : coût par requête, coût par cas d'usage, ROI d'une initiative IA.

Pourquoi les coûts IA sont-ils si difficiles à prévoir ? Les coûts IA sont variables par nature : ils dépendent du volume de requêtes, du modèle utilisé, de la longueur des prompts et des réponses, et du mode de traitement (temps réel ou batch). Contrairement à une infrastructure dimensionnée à l'avance, un service IA peut voir sa consommation varier fortement sans modification d'architecture.

Comment réduire les coûts d'un projet IA sans dégrader la qualité ? Trois leviers principaux : choisir le modèle adapté à la complexité de la tâche, mettre en place une gouvernance du prompt pour réduire la consommation de tokens, et définir des budgets par utilisateur et par équipe pour éviter les dérives structurelles.

Le FinOps peut-il contribuer à réduire l'empreinte carbone de l'IA ? Oui, directement. Optimiser les coûts IA revient souvent à réduire les volumes de calcul inutiles, ce qui diminue mécaniquement la consommation énergétique. Le choix de la région d'hébergement est également déterminant : les émissions sont jusqu'à 6 fois inférieures en France par rapport à la Chine pour un même modèle GPU (Alt IMPACT, mars 2025).

Qu'est-ce que le FinOps "by design" ? Le FinOps "by design" consiste à intégrer la dimension financière dès la conception d'un projet IA, avant son déploiement. Il s'agit d'arbitrer en amont le choix du modèle, la fréquence d'utilisation, le type d'infrastructure et le mode de traitement pour éviter des dérives structurelles difficiles à corriger a posteriori.

Sources : Gartner (2025) : dépenses cloud mondiales ; Agence Internationale de l'Énergie, rapport "Energy and AI" (avril 2025) ; Programme Alt IMPACT, Analyse de Cycle de Vie de GPU pour l'IA (mars 2025).

Co-auteurs : Clément Mary et Simon Charpiot.